[Réussir à discuter avec les modèles de base des Outils IA avec moins d’hallucinations]

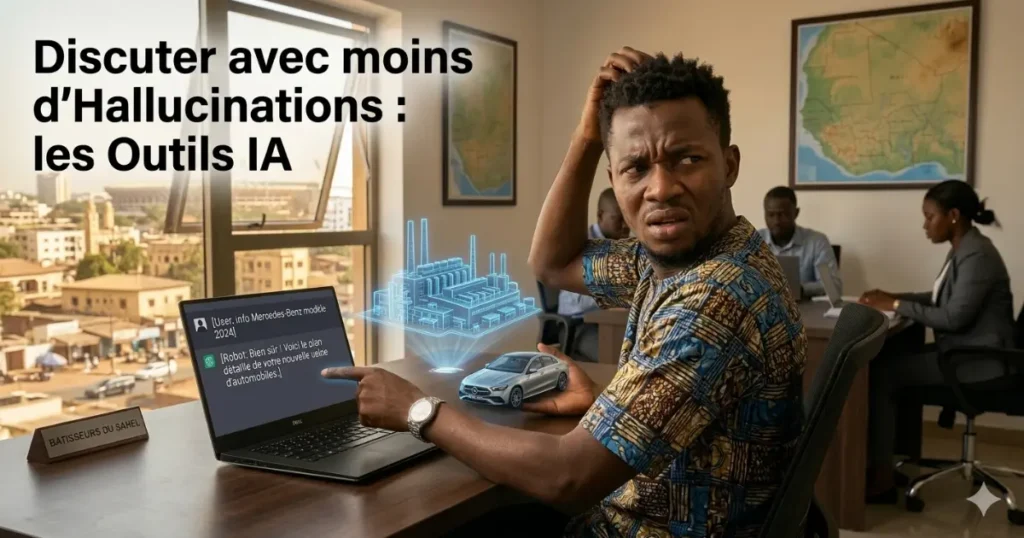

Comment discuter avec moins d’hallucinations : les Outils IA. Discuter avec une IA, ce à quoi la plupart d’entre nous sommes habitué. Il est difficile de passer la journée sans rendre visite à l’une des IA génératives [GPT, Claude, Gemini ou LLaMA]. Que ce soit pour une simple discussion, une recherche sur un sujet ou la préparation de vos dossiers. C’est frustrant de lancer une demande d’informations sur le dernier modèle Mercedes et de recevoir à la place un plan de construction de bâtiment.

Qu’est-ce qu’une hallucination d’IA ?

Une hallucination se produit quand une IA donne une réponse qui semble plausible, mais qui est fausse ou inventée. Elle peut fournir une réponse parfaitement cohérente, fluide et convaincante sur la forme, mais qui est factuellement fausse ou totalement inventée sur le fond. Elle « invente » alors des sources, des dates ou des fonctionnalités qui n’existent pas.

Quand l’IA hallucine, elle répète souvent les mêmes interactions pendant quelques instants. C’est le cas de Nano Banana dans sa version limitée : quand vous lui donnez un prompt pour générer un visuel, elle vous dit « voici le visuel demandé » alors que l’interface est vide. Et quand vous lui signalez qu’il n’y a pas d’image générée, elle répète le même scénario, et toujours rien.

Hallucinations des outils IA : du mensonge ?

L’intelligence artificielle, dans son modèle gratuit ou limité, est très sujette aux hallucinations. Même les modèles leaders comme ChatGPT ou Gemini voient leurs performances s’éroder dans leurs versions gratuites. La saturation des serveurs et le partage massif des ressources limitent la capacité d’analyse de l’IA, la poussant parfois à l’hallucination.

Pour compenser ce déficit de puissance de calcul et maintenir une interaction fluide, le système génère des approximations ou des répétitions. C’est la limite majeure des offres gratuites. La rapidité de réponse prime souvent sur la rigueur de l’analyse.

Ces modèles finissent par halluciner, à l’image d’un interlocuteur qui s’efforcerait de tenir un discours cohérent sans maîtriser son sujet. Pour vos projets sérieux, une vigilance accrue est donc de mise.

Ne validez jamais une réponse d’IA sans vérification préalable. Les solutions que je vais partager avec vous sont conçues pour vous aider à filtrer l’information et à distinguer rapidement le vrai du faux.

Comment discuter « intelligemment » avec une IA

Pour ne pas ramasser tout ce qu’elles vous donnent, réduire les erreurs et obtenir des résultats satisfaisants comme un pro, voici les bonnes pratiques que nous avons dégagées :

- La technique du « Prompt Intelligent » : Soyez extrêmement précis dans vos instructions. Au lieu de demander simplement de « développer le contenu », fixez des limites claires et demandez des sources vérifiables.

- Le test de l’actualité : Avant de commencer une session complexe, vérifiez si l’IA est « réveillée » et à jour en lui demandant, par exemple, l’année actuelle ou un fait récent.

- Le cross-referencing (comparaison) : Ne jamais se fier à une seule IA pour une information technique cruciale. Comparez les réponses de plusieurs modèles (Gemini, Mistral, Claude, etc.) pour identifier les contradictions.

Par exemple : si vous discutez avec ChatGPT et qu’il vous donne une réponse que vous ne comprenez pas, copiez cette réponse et collez-la dans une nouvelle discussion avec Gemini en lui demandant une explication. Vous pouvez même la passer à une troisième IA jusqu’à bien comprendre. Quand on discute avec les IA, il faut être plus malin en posant ses questions pour obtenir les meilleures réponses.

Utiliser une IA qui n’est pas à jour

C’est un point crucial auquel peu de personnes font attention, surtout avec les applications tierces disponibles sur les Market d’applications. Beaucoup de ces outils utilisent des modèles qui ne sont pas toujours à jour.

Même si vous y retrouvez les grands noms de l’IA, restez prudent : ces applications accusent souvent un retard technique. Aujourd’hui, avec l’ère de l’IA, tout bouge très vite. En une seule année, des changements majeurs sont enregistrés, et si vous utilisez une version dépassée, cela peut poser problème pour la pertinence de vos résultats.

Si vous voulez savoir si une IA est à jour ou non, demandez-lui simplement en quelle année nous vivons. C’est dans ces applications que beaucoup d’IA semblent vivre dans le passé, parfois 3 ou 4 ans en arrière. Elles peuvent donc vous donner des informations qui ne sont plus valides aujourd’hui.

Pour vos projets importants, cela représente une perte de temps et vos chances de réussite diminuent. Une IA qui ne peut pas chercher sur Internet, consulter une base de données ou vérifier des sources va sûrement inventer plus facilement pour compléter sa réponse.

Toutes les IA hallucinent, même avec abonnement

Bien que les modèles payants disposent de plus de ressources pour « réfléchir » longuement et chercher des solutions précises, le risque zéro n’existe pas. Plus l’IA peut puiser loin, moins il y aura de « mensonges » dans ses réponses, mais elle n’est pas infaillible.

Face à une difficulté, il arrive qu’elles répètent les mêmes gestes ou fassent des retours au début de la discussion. Les mêmes réponses tournent en boucle. Elles peuvent aussi donner des suggestions inattendues, un peu comme quelqu’un qui cherche à fuir des questions auxquelles il ne peut pas répondre.

Si vous travaillez beaucoup sur Internet, prendre un abonnement reste une excellente solution. Ce n’est pas une garantie à 100 %, mais c’est l’assurance d’avoir beaucoup moins d’erreurs qu’avec un modèle gratuit.